Germane Cognitive Load

क्यों दिमाग सबसे अच्छा सीखता है… जब उसे सबकुछ तुरंत न मिले

भाषा सीखने में दिमाग तब सबसे अच्छा काम करता है जब उसे सूचनाओं को जोड़ना पड़ता है, न कि सिर्फ अनुवाद पा लेना। संवादों को इस तरह डिज़ाइन किया गया है कि वे पूरा उत्तर न दें, जिससे उपयोगकर्ता खुद अनुमान लगाए, जोड़-घटाव करे और अर्थ का निर्माण करे। Germane Cognitive Load का सिद्धांत बताता है कि यही प्रयास हमारे दिमाग में स्थायी ज्ञान संरचनाएँ बनाता है — यही वह तरीका है जिससे छोटे बच्चे भाषा सीखे बिना याद किए, लगातार सुनते और समझते हैं। रिसर्च से साबित है कि ‘सही मात्रा की कठिनाई’ और ‘समझ में आने वाली अस्पष्टता’ दीर्घकालिक भाषा अधिग्रहण को बढ़ावा देती हैं — भाषा सिखाई नहीं जाती, यह हमारे दिमाग द्वारा स्वाभाविक रूप से निर्मित होती है।

सच्ची भाषा अधिग्रहण रटने से नहीं, अनुभव से आती है

Cognitive Load Theory

स्नायु-विज्ञान के अनुसार, दिमाग ‘वास्तव में’ तभी सीखता है जब उसे खुद अपनी समझ बनाने के लिए संज्ञानात्मक प्रयास करना पड़ता है — इसे “Germane Cognitive Load” कहा जाता है। यह विचार Cognitive Load Theory (Sweller, 1988) जैसा कि संज्ञानात्मक बोझ को तीन हिस्सों में बांटता है:

- Intrinsic Load – विषय की कठिनाई, जैसे जापानी उच्चारण अंग्रेज़ी से कठिन है

- Extraneous Load – अतिरिक्त बोझ, जैसे भ्रमित करने वाली शिक्षा या भारी-भरकम स्क्रीन

- Germane Load – ‘अच्छा बोझ’ क्योंकि यह नई जानकारी को पुराने अनुभवों के साथ जोड़ता है

जब हम दिमाग को खुद सोचने, विश्लेषण करने और जोड़ने का मौका देते हैं, वह खुद के भीतर स्कीमा या “समझ की रूपरेखा” बनाता है — यही है असली अधिग्रहण की प्रक्रिया।

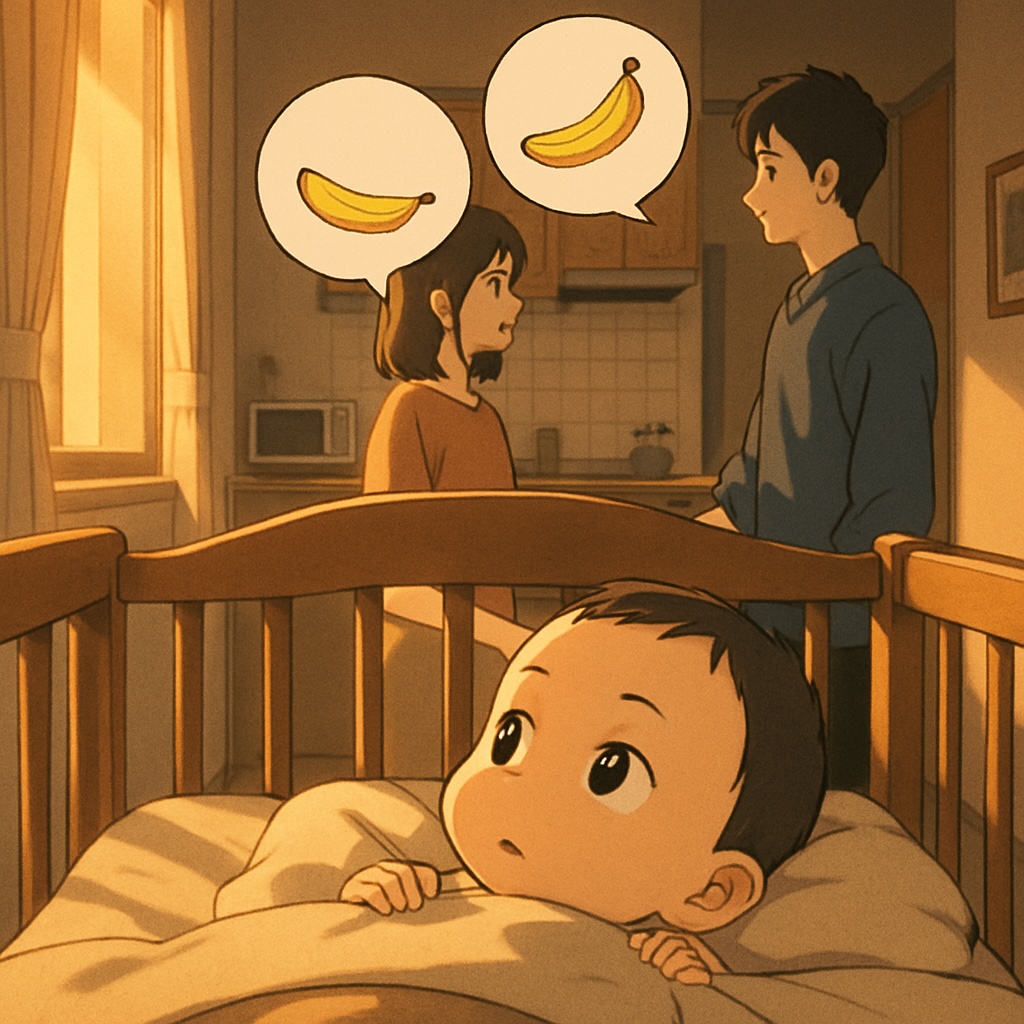

छोटे बच्चे ऐसे ही स्वाभाविक रूप से भाषा सीखते हैं

Patricia Kuhl (University of Washington) के अध्ययन दिखाते हैं कि 6–12 महीने के बच्चे statistical learningका उपयोग करते हैं — यानी शब्द और ध्वनि पैटर्न को बार-बार सुनकर खुद ही पैटर्न पकड़ना। जैसे बार-बार “banana” सुनने से दिमाग समझता है कि ये तीन ध्वनियां एक शब्द बनाती हैं। बच्चे संदर्भ से सीखते हैं, अनुवाद से नहीं: जब माँ कहती है, “खाना खाओ” और चम्मच पकड़े होती है, तो बच्चा ‘खाना’ शब्द को खाने और खुशी के माहौल से जोड़ता है। वह पहली बार में सबकुछ समझता नहीं, लेकिन अनुभवों के繰ाबार-बार मिलने से उसका दिमाग टुकड़े जोड़ता जाता है। यही प्राकृतिक germane load है।

“Desirable Difficulty” – दिमाग को विकसित करने वाली सही कठिनाई

Robert Bjork (UCLA) इसे Desirable Difficulty कहते हैं — जब दिमाग के सामने चुनौतियाँ ‘बस सही’ स्तर की होती हैं, तब वह सर्वश्रेष्ठ ढंग से सीखता है:

- बहुत आसान → दिमाग में कोई प्रक्रिया नहीं

- बहुत मुश्किल → दिमाग हार मान लेता है

- सही स्तर → दिमाग नई समझ बनाने में प्रयास करता है

यही वजह है कि भाषा सीखना ‘जिसमें सब समझाया न जाए’ दिमाग के लिए आदर्श कठिनाई पैदा करता है — जिससे सेलुलर कनेक्शन (synaptic strengthening) और neuroplasticity सबसे अधिक सक्रिय होती है।

Germane Cognitive Load के पीछे का विज्ञान

भाषा सिखाने वाले ऐप में छोटा संवाद देखें:

👧 “昨日、映画を見たよ。”

きのう、えいがをみたよ。

kinō, eiga o mita yo.

🧒 “へえ、誰と?”

へえ、だれと?

hē, dare to?

👧 “友だちと。とても楽しかった!”

ともだちと।とてもたのしかった!

tomodachi to. totemo tanoshikatta!

यहाँ ऐप हर शब्द का अर्थ तुरंत नहीं बताता; जैसे 昨日 (きのう / kinō — कल) या 楽しかった (たのしかった / tanoshikatta — बहुत मज़ा आया)। लेकिन संदर्भ (फ़िल्म, दोस्त) देखकर यूज़र खुद अनुमान लगा सकते हैं कि बात अच्छी अनुभव साझा करने की हो रही है।

इसमें दिमाग को करना होता है:

• संदर्भ जोड़ना → अर्थ अनुमान करना

• क्रिया-पैटर्न पर ध्यान → ‘~た’ से अर्थ निकालना कि बात अतीत की है

• बार-बार इस पैटर्न को देखने से समझ और मजबूत होती है

यही वह तरीका है जिससे छोटे बच्चे शुरू से सीखते हैं — लेकिन यह तरीका अब बड़ों की तेज़, प्रभावशाली शिक्षा के लिए डिज़ाइन किया गया है।

Nick Ellis (University of Michigan) ने पाया कि ‘संतुलित अस्पष्टता’ (manageable ambiguity) दिमाग को Bayesian inference मोड में डाल देती है — यानी अनुमान लगाना और संदर्भ के आधार पर समझ बदलना। थोड़ी अस्पष्टता = दिमाग के लिए ईंधन। जब यूज़र संदर्भ से अर्थ निकालता है, तो वह उत्तर की प्रतीक्षा नहीं करता बल्कि खुद एक वैज्ञानिक की तरह सबसे अच्छा स्पष्टीकरण गढ़ता है। नतीजा — active सीखना, जिसमें दिमाग खुद अर्थ गढ़ता है, न कि बस जवाब लेता है।

अब जब AI पल भर में सब बता सकता है, सबसे ज़रूरी है कि यूज़र सोचने की आदत न खो दें — वरना germane cognitive load घट जाता है। MIT के रिसर्च से पता चला है कि LLM (जैसे ChatGPT) यूज़र का दिमागी सक्रियता (EEG activity) उनकी तुलना में काफी कम कर देता है, जो खुद विचार-विमर्श करके लिखते हैं। इसी वजह से भाषा प्रशिक्षण में AI को ‘सोच का कोच’ (Cognitive Coach) बनना चाहिए न कि ‘ऑटो डिक्शनरी’। जैसे — AI यूज़र से पूछ सकता है, “आपको क्या लगता है, इस संदर्भ में यह शब्द क्या अर्थ रखता है?” या केवल उन्हीं हिस्सों पर फीडबैक देना जहाँ यूज़र को दिक्कत हो। यह तरीका germane load को बनाए रखता है।

मानव सबसे बेहतर भाषा तब सीखता है जब उसका दिमाग:

- असल संदर्भ में सामग्री पाता है

- खुद अर्थ निकालता है

- सटीक फीडबैक पाता है

- नई परिस्थितियों में दोहराता है

बच्चा इससे हज़ारों बार गुजरता है, तब जाकर बोलता है। वयस्क भी इसी प्रक्रिया का इस्तेमाल कर सकते हैं, बस तकनीक मदद कर सकती है ‘सोचने के लिए उकसाने’ में, न कि ‘हर उत्तर’ बताने में। भाषा अधिग्रहण का असल अर्थ शब्द जमा करना नहीं, बल्कि दिमाग को ‘अनुमान लगाने, जोड़ने और सटीक समझ बनाने’ के लिए प्रशिक्षित करना है — जैसा हमने बचपन में अपनी पहली बोली बोलने से पहले किया था।

References:

- Sweller, J. (1988). Cognitive load during problem solving: Effects on learning. Cognitive Science.

- Bjork, R. A. (1994). Memory and metamemory considerations in the training of human beings.

- Kuhl, P. K. (2004). Early language acquisition: Cracking the speech code. Nature Reviews Neuroscience.

- Ellis, N. C. (2002). Frequency effects in language processing: A review with implications for theories of implicit and explicit language learning. Studies in Second Language Acquisition.

- MIT Media Lab (2025). Your Brain on ChatGPT: Accumulation of Cognitive Debt (preprint).